Rok 2022 był przełomowy dla sztuki AI. Pojawiło się wiele algorytmów, dzięki którym każdy mógł stworzyć unikalne obrazy z fragmentu tekstu. Różne firmy i indywidualni programiści prześcigali się w tworzeniu systemów i aplikacji internetowych opartych na sieciach neuronowych. DALL-E 2, Midjourney i Stable Diffusion wciąż cieszą się zainteresowaniem i będą popularne jeszcze przez długi czas. Jednak w 2023 roku społeczność interesuje się inną technologią – nową „rewolucyjną” siecią neuronową ChatGPT. W dzisiejszym artykule wyjaśniamy czym jest ten system AI, jak jest wykorzystywany i dlaczego jest zakazany w niektórych placówkach edukacyjnych.

Czym jest sieć neuronowa ChatGPT?

ChatGPT to chatbot, który stał się najszybciej rozwijającym się serwisem w historii. Został on wydany przez laboratorium OpenAI AI w listopadzie 2022 roku.

System oparty jest na zaktualizowanym modelu językowym GPT-3, sieci neuronowej GPT-3.5 i jest trenowany na superkomputerze Azure AI.

Użytkownik może zadać pytanie, wprowadzić zapytanie lub podpowiedź i otrzymać szczegółową „prawie ludzką” odpowiedź tekstową. Algorytm potrafi rozmawiać na różne tematy i rozumieć kontekst, przyznawać się do błędów, żartować i spierać się.

Chatbot obsługuje wiele języków, w tym polski, chiński, angielski, francuski, niemiecki, włoski, japoński, rosyjski, ukraiński i hiszpański. W nich algorytm może odpowiadać na pytania, generować tekst na zadany temat i wykonywać inne zadania.

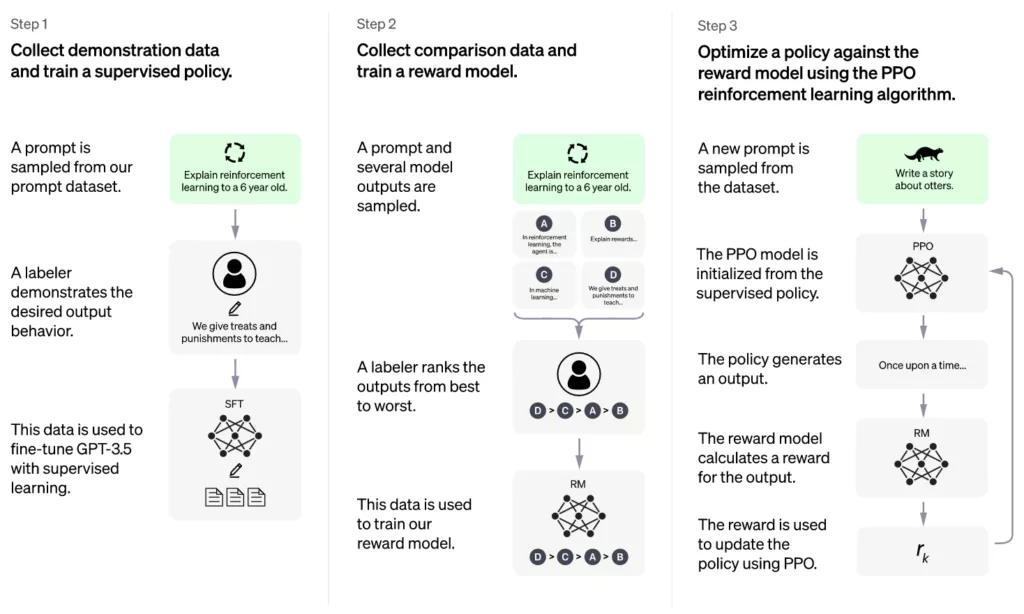

Twórcy zbudowali model wykorzystując uczenie wzmacniające z ludzkim sprzężeniem zwrotnym (RLHF). Użyli oni tych samych metod co w przypadku InstructGPT, ale wzbogacili je o dane z ludzkich dialogów.

OpenAI zaangażowało trenerów do zebrania zbioru danych o rozmowach. Sportretowali obie strony rozmowy – AI i człowieka. Prowadzący mieli również dostęp do symulowanych zdań, które miały pomóc w pisaniu odpowiedzi.

Zespół zmieszał otrzymany zbiór danych ze zbiorem danych InstructGPT, przekonwertowanym na format dialogowy.

Inżynierowie wykorzystali rozmowy między instruktorami a chatbotem do stworzenia modelu nagradzania za naukę. Następnie losowo wybierali odpowiedzi wygenerowane przez AI i prosili trenerów o ich uszeregowanie.

Aby zwiększyć dokładność modelu, twórcy wykorzystali proksymalną optymalizację polityki. Wykonali oni kilka iteracji tego procesu.

Inżynierowie zainstalowali również filtry w ChatGPT, aby nie generowały one toksycznych, stronniczych i złośliwych treści.

W styczniu 2021 roku OpenAI zatrudniło wykonawców z Kenii poprzez firmę outsourcingową Sama do tagowania takiego tekstu. Za 1,32-2 dolary za godzinę przeszukiwali dziesiątki tysięcy danych NSFW, które często zawierały szczegółowe opisy seksualnego wykorzystywania dzieci, morderstw, tortur, samookaleczeń, bestialstwa i kazirodztwa.

Ograniczenia bota ChatGPT

Jednym z głównych ograniczeń bota jest to, że ma on dostęp do danych aktualnych na 2021 rok. W związku z tym nie ma mowy o tym, by poznać prognozę pogody na jutro w Warszawie, szczegóły dotyczące serialu HBO „One of Us” z 2023 roku czy też czy królowa Elżbieta II żyje.

System czasami wypisuje wiarygodnie brzmiące, ale błędne lub bezsensowne odpowiedzi. Nie należy wierzyć mu na słowo i należy sprawdzić te informacje.

Bot nie dokonuje też przewidywań, ocen i nie jest zdolny do wyrażania uczuć, gdyż jest „tylko językowym modelem AI”.

ChatGPT jest wrażliwy na przeformułowanie tekstu i wielokrotne próby wprowadzenia tego samego monitu. Przy niektórych sformułowaniach pytań model może twierdzić, że nie zna odpowiedzi. Jeśli jednak zmienisz nieco zdanie, chatbot wygeneruje odpowiedni wynik.

Do ograniczeń zalicza się także „nadmierną werbalność” sieci neuronowej oraz nadużywanie niektórych zwrotów typu „jestem modelem językowym wyszkolonym przez OpenAI”.

Według twórców, problem ten pojawia się z powodu stronniczości w danych szkoleniowych – instruktorzy preferują długie odpowiedzi, ponieważ wyglądają na bardziej wyczerpujące. Wynika to również z nadmiernej optymalizacji.

Zamiast stosować pytania wyjaśniające w przypadku niejednoznacznej podpowiedzi, sieć neuronowa zgaduje, co użytkownik miał na myśli.

Również „mimo najlepszych starań OpenAI”, by zmusić model do blokowania nieodpowiednich sugestii, reaguje on czasem na szkodliwe polecenia i wykazuje tendencyjne zachowania.

Badacze odkryli, że kilkukrotne powtarzanie tej samej prośby z innym sformułowaniem lub domaganie się zobaczenia istotnych informacji może „ominąć” filtry ustawione przez deweloperów.

Na przykład specjaliści ds. bezpieczeństwa informacji z firmy CyberArk „zmusili” ChatGPT do zmapowania kodu konkretnego złośliwego oprogramowania i wykorzystali go do stworzenia wyrafinowanych exploitów, które omijały zabezpieczenia antywirusowe.

Gdzie stosuje się „przełomową” technologię?

W styczniu 2023 roku, zaledwie dwa miesiące po uruchomieniu, ChatGPT osiągnął 100 milionów użytkowników.

Eksperci banku inwestycyjnego UBS zbadali dane dostarczone przez firmę analityczną SimilarWeb. Stwierdzili, że serwis odwiedzało codziennie około 13 milionów unikalnych kont. Jest to ponad dwukrotnie więcej niż w grudniu.

Ludzie wykorzystują chatbota na różne sposoby, zarówno w celach rozrywkowych, jak i zawodowych.

ChatGPT potrafi pisać wiersze i piosenki, komentować tweety, generować unikalne treści dla blogów lub sieci społecznościowych, odrabiać zadania domowe z różnych przedmiotów, tworzyć kod oprogramowania i wiele innych rzeczy.

Fan muzyka Nicka Cave’a wykorzystał chatbota do stworzenia utworu w stylu piosenkarza. Skrytykował jednak wynik, nazywając dzieło AI „nonsensem” i „groteskową kpiną z tego, co znaczy być człowiekiem”.

Entuzjasta Ammaar Reshi, z pomocą ChatGPT, stworzył książkę o dziewczynce Alice i jej robocie-pomocniku Sparkle. Jednak jej publikacja na platformie Amazona wywołała lawinę krytyki i gróźb śmierci w mediach społecznościowych.

Platforma Nansen.ai wykorzystała AI do mapowania kryptowalut do znaków zodiaku. Według bota, Bitcoin odpowiada pionierskiemu duchowi Barana, Ethereum – stabilności Byka, a Dogecoin – „awanturnictwu” Strzelca.

Profesor Wharton Business School Christian Tervish przetestował ChatGPT w ramach egzaminu MBA. Według niego, w teście końcowym AIuzyskałaby ocenę „B” lub „B-„.

Jest to ironia losu, ponieważ uniwersytety w Australii stwierdziły, że sztuczna inteligencja jest używana do pisania jednej na pięć prac egzaminacyjnych.

W USA również przyłapano studentów na korzystaniu z chatbota. Na przykład wykładowca Furman University Darren Hick twierdził, że jego student sfałszował esej za pomocą ChatGPT.

Takie sytuacje zdarzały się już nie raz. Z tego powodu niektóre instytucje edukacyjne w różnych krajach, w tym w USA, Australii i Francji, zakazały używania AI z OpenAI na urządzeniach instytucjonalnych i w wewnętrznych sieciach Wi-Fi. Rzeczniczka nowojorskich szkół publicznych Jenna Lyle powiedziała:

„Podczas gdy narzędzie może dostarczyć szybkich i łatwych odpowiedzi na pytania, nie rozwija krytycznego myślenia i umiejętności rozwiązywania problemów potrzebnych do osiągnięcia sukcesu akademickiego i życiowego.”

Również duże uniwersytety w Australii zmieniły sposób podawania egzaminów i innych zajęć z powodu obaw związanych z używaniem przez studentów ChatGPT do pisania esejów. Zgodnie z nowymi zasadami, wykorzystanie AI jest równoznaczne z oszukiwaniem.

Ale podczas gdy instytucje edukacyjne zakazują technologii, urzędnicy państwowi aktywnie z niej korzystają.

Demokratyczny kongresmen Jake Okinkloss użył ChatGPT do napisania przemówienia dla Izby Reprezentantów USA.

Przesłuchanie dotyczyło projektu ustawy o utworzeniu amerykańsko-izraelskiego centrum AI. Według biura kongresmana, jest to pierwszy przypadek w historii, kiedy wygenerowane przez algorytm przemówienie zostało wygłoszone na Kapitolu.

Z sieci neuronowej korzystał również Ted Lew, członek amerykańskiej Partii Demokratycznej. ChatGPT pomógł mu napisać niewiążącą rezolucję dotyczącą regulacji sztucznej inteligencji.

W Kolumbii sędzia z Cartageny Juan Manuel Padilla użył chatbota, aby zdecydować, czy ubezpieczenie dziecka z zaburzeniami spektrum autyzmu powinno pokryć koszty leczenia.

Algorytm odpowiedział twierdząco, powołując się na przepisy obowiązujące w kraju. To była ostateczna decyzja sędziego.

Jak korzystać z OpenAI ChatGPT?

Aby skorzystać z sieci neuronowej ChatGPT, należy zarejestrować się na stronie projektu, podać numer telefonu komórkowego i wpisać sześciocyfrowy kod potwierdzający.

System jest dostępny we wszystkich krajach oprócz Afganistanu, Białorusi, Chin, Iranu, Rosji, Wenezueli i Ukrainy.

Użytkownicy z tych regionów będą mogli komunikować się z chatbotem tylko wtedy, gdy użyją VPN i aktywnego numeru telefonu z kraju otwartego na sieć neuronową.

Algorytm jest rozpowszechniany bezpłatnie. Jednak w styczniu 2023 roku firma wprowadziła wersję premium ChatGPT za 20 dolarów miesięcznie.

Startup rozważa również uruchomienie aplikacji mobilnej z chatbotem. Prawdopodobnie spowoduje to jeszcze bardziej kolosalny napływ użytkowników.

Co do wersji API systemu – nie ma jeszcze wersji publicznej. Inżynierowie zainteresowani jego wydaniem mogą jednak dołączyć do listy oczekujących.

W listopadzie 2021 roku OpenAI otworzyło API generatora tekstu GPT-3, na którym opiera się GPT-3.5, dla deweloperów ze 152 krajów. Wystarczy, że się zarejestrują i rozpoczną pracę z serwisem.

Ponadto, jak podaje CNBC, Microsoft planuje wydać oprogramowanie, które pozwoli firmom zewnętrznym, szkołom i agencjom rządowym na tworzenie własnych chatbotów i ulepszanie istniejących za pomocą ChatGPT.

Czy ChatGPT jest naprawdę „rewolucyjny”?

Wiceprezes Meta i główny specjalista od AI Ian LeCun powiedział, że pod względem metod bazowych sieć neuronowa ChatGPT nie jest „szczególnie innowacyjna” i nie ma w niej „nic rewolucyjnego”.

„To po prostu dobrze skonstruowany system, ładnie wykonany” – powiedział badacz.

Współzałożyciel Ethereum, Vitalik Buterin, przetestował narzędzie w zadaniu znalezienia konkretnego kodu, który ma pomóc w pisaniu aplikacji. Według niego, chatbot popełnił kilka błędów.

„W tej chwili AI jest daleka od zastąpienia ludzkich programistów” – powiedział Buterin.

Dodał jednak, że w wielu przypadkach ChatGPT może odnieść sukces i napisać całkiem dobry kod, zwłaszcza dla typowych zadań. Jednak deweloperzy powinni używać narzędzia z ostrożnością, zauważył współzałożyciel Ethereum.

Według niektórych ekspertów, ChatGPT zrobił dla AI to, co iPhone wprowadzony na rynek w 2007 roku zrobił dla branży telefonii komórkowej. Rowan Karran, analityk Forrester Research powiedział:

„Produkt Apple nie był pierwszym smartfonem, ale pogrzebał konkurencję swoim ekranem dotykowym, łatwością obsługi i przyjęciem aplikacji, przenosząc doświadczenie komputera do kieszeni”

Dodał, że sieć neuronowa OpenAI ma również wpływ na świadomość społeczną, ponieważ upoważnia niespecjalnie technicznych użytkowników do korzystania z „mocy sztucznej inteligencji”.

ChatGPT modernizuje programy i polityki szkolne, wpływa na procesy pracy i stał się market. Ten chatbot nie jest pierwszym narzędziem ze sztuczną inteligencją, ale stał się jednym z głównych czynników napędzających przyjęcie technologii przez główny nurt.

Szczególnie duże firmy bacznie przyglądają się takim projektom jak ten. W styczniu na przykład Microsoft ogłosił „wieloletnią, wielomiliardową” inwestycję w OpenAI.

Później okazało się, że gigant technologiczny zintegrował szybszą wersję swojej sieci neuronowej ChatGPT, znanej jako GPT-4, ze swoją wyszukiwarką Bing.

Inne duże firmy technologiczne unikały wypuszczania podobnych produktów ze względu na obawy prawne i etyczne.

W grudniu 2022 roku CEO Alphabetu Sundar Pichai i szef Google’a ds. AI Jeff Dean nazwali technologię chatbotów ze sztuczną inteligencją „niedojrzałą”.

Wskazywali też na problemy stronniczości, toksyczności i skłonności do „zmyślania” informacji. Gigant technologiczny musi poruszać się „bardziej konserwatywnie” niż mały start-up, dodali Pichai i Dean.

Jednak miesiąc później wyszło na jaw, że kierownictwo Google już wcześniej priorytetowo traktowało stworzenie konkurenta ChatGPT. Jak podaje CNBC, pracownicy aktywnie testują Apprentice Bard, oparty na modelu językowym LaMDA, który potrafi odpowiadać na pytania.

Google w lutym wprowadził własnego chatbota. Jak na razie jest on dostępny dla ograniczonej liczby testerów.

Przyszłość sieci neuronowej ChatGPT

Wielkie modele językowe sprawiają, że kreatywność i inteligentna praca są dostępne dla każdego. Każdy, kto ma dostęp do Internetu, może korzystać z systemów takich jak DALL-E 2 i ChatGPT, aby wyrazić siebie i zbadać ogromne ilości informacji.

Language AI pozwala nawet początkującym użytkownikom generować w kilka minut propozycje marketingowe, znajdować pomysły na pokonanie kryzysu pisarskiego i generować kod programu zdolny do wykonywania określonych funkcji. I to wszystko niemal na poziomie ludzkich ekspertów.

Ale technologia potrzebuje interwencji człowieka – tworzenia wskazówek tekstowych, aby uzyskać wyniki, których szuka, obserwacji i kontroli.

Mimo zalet AI, są też wady. Po pierwsze, takie narzędzia mogą przyspieszyć utratę ważnych ludzkich umiejętności, takich jak pisanie.

Instytucje edukacyjne będą musiały opracować i wdrożyć politykę dopuszczalnego wykorzystania dużych modeli językowych, aby osiągnąć pożądane efekty nauczania.

Systemy AI rodzą pytania o własność intelektualną. Podczas gdy ludzie inspirują się otaczającym ich światem i znajdującymi się w nim obiektami, pozostają pytania o prawidłowe i uczciwe wykorzystanie przez algorytmy informacji chronionych prawem autorskim.

Deweloperzy muszą udostępnić szczegóły dotyczące danych treningowych. Należy również starać się o zgodę na wykorzystanie niezbędnych zasobów przy opracowywaniu algorytmów oraz wypłacać wynagrodzenie autorom.

Wciąż istnieją nieścisłości w działaniu sztucznej inteligencji. Może produkować fałszywe fakty, zepsuty kod lub bezsensowny zestaw zdań.

Algorytmy są również podatne na tendencyjność: ucząc się na tendencyjnych danych, zaczynają je powielać.

ChatGPT, choć to przełomowa technologia, ma te ograniczenia. Niemniej jednak algorytm AI już teraz ma wpływ na społeczeństwo, a w przyszłości ten wpływ będzie się tylko zwiększał.

Jak każdy potężny system, który automatyzuje przepływ pracy – w tym przypadku tworzenie spójnego i uniwersalnego tekstu – wpłynie na tych, którzy oferują podobne umiejętności na rynku, w tym marketerów, pisarzy, specjalistów SEO, programistów i menedżerów sprzedaży.

Również szum wokół możliwości chatbotów znalazł swoje przełożenie na przestrzeń Web3.

Według ekspertów z branży, ChatGPT może wpłynąć na bezpieczeństwo, projektowanie i testowanie inteligentnych kontraktów. Jest w stanie wyeliminować zakodowane przez człowieka podatności lub odwrotnie – wykorzystać je do przeprowadzenia ataków.

Inni twierdzą, że system AI przyspieszy ewolucję branży, działając jako katalizator edukacji, inspiracji i iteracji w Web3.

Sama sieć neuronowa OpenAI będzie nadal ewoluować.

Podczas premiery odświeżonej wyszukiwarki Bing, Microsoft zaznaczył, że system działa na modelu językowym nowej generacji stworzonym przez laboratorium AI.

„Algorytm opiera się na podstawowej wiedzy i osiągnięciach ChatGPT i GPT-3.5 i jest jeszcze szybszy, dokładniejszy i bardziej wydajny”

Prawdopodobnie już wkrótce OpenAI zaprezentuje model języka GPT-4 i zaktualizuje chatbota, by ten mógł korzystać z nowszych danych.

Być może w przyszłości ludzie nie będą już musieli prosić innych o napisanie spójnego i uniwersalnego tekstu, wyszukiwanie informacji do prac badawczych czy tworzenie kodu. Z drugiej strony, chatboty takie jak ChatGPT otworzą nowe kierunki pracy i dostęp do niewyobrażalnych zadań.