Naukowcy z Google opracowali algorytm, który potrafi napisać własny kod programistyczny dla robotów na podstawie instrukcji w języku naturalnym.

PaLM, our latest & most capable language model, can unlock new possibilities in robotics.

— Google AI (@GoogleAI) November 2, 2022

For example, read about Code as Policies, an approach that, when given natural language instructions, uses language models to write code that controls robots→ https://t.co/hTJ9kbgMdq (2/3) pic.twitter.com/5j11oPVSsJ

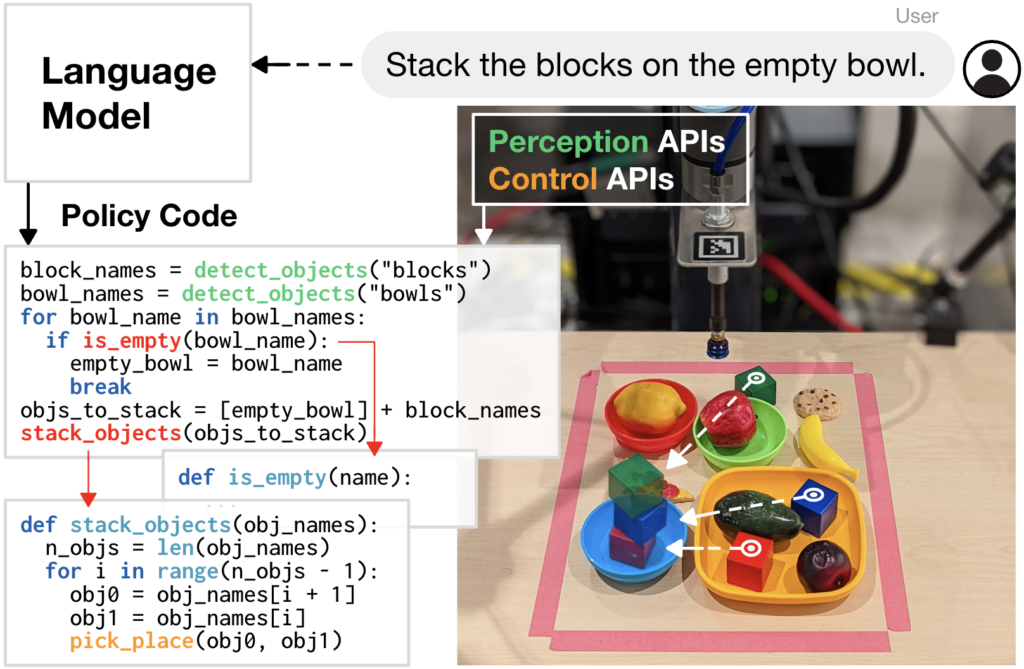

Model językowy Code as Policies (CaP), oparty na PaLM, ma za zadanie interpretować instrukcje języka naturalnego i przekształcać je w kod, który robot może wykonać.

Badacze wytrenowali algorytm, dostarczając mu przykłady w formacie komentarzy od programistów i powiązany z nimi kod. Dzięki temu CaP mógł otrzymać nowe instrukcje. Deweloperzy napisali:

Model autonomicznie generuje kod, który rekonfiguruje wywołania API, syntetyzuje funkcje i wyraża pętle zwrotne, aby stworzyć nowe zachowanie w czasie rzeczywistym.

Aby skłonić CaP do napisania nowego kodu dla konkretnych zadań, zespół dostarczył mu „wskazówki”, takie jak dostępność API lub narzędzi, a także kilka przykładów sparowanych instrukcji. Dzięki temu model może tworzyć programy dla robota.

Według twórców, CaP może rekurencyjnie definiować nowe funkcje, gromadzić własne biblioteki i samodzielnie tworzyć dynamiczną bazę kodu.

Otrzymując raz jeden zestaw instrukcji, może opracować pewien kod, który później może być ponownie przypisany do podobnych instrukcji.

CaP może używać operacji arytmetycznych i logiki z niektórych języków. Na przykład model wytrenowany w Pythonie używa w razie potrzeby odpowiednich pętli if/else i for/while. Może również korzystać z bibliotek stron trzecich dla dodatkowej funkcjonalności.

Inżynierowie zauważyli, że możliwości CaP są wciąż mocno ograniczone. Polega na modelu językowym, aby zapewnić kontekst dla swoich instrukcji. Jeśli podpowiedzi nie mają sensu, CaP nie może pisać kodu.

Ponadto model nie jest w stanie obsłużyć kilkudziesięciu parametrów jednocześnie.

Przypomnijmy, że w czerwcu 2021 roku GitHub wprowadził oparte na sztucznej inteligencji narzędzie do autouzupełniania kodu – Copilot. Model językowy dla narzędzia został opracowany przez OpenAI.

W październiku 2022 roku programiści ogłosili zamiar pozwania Microsoftu za wytrenowanie sztucznej inteligencji przy użyciu ich kodu.